原文:https://openai.com/blog/planning-for-agi-and-beyond/

Planning for AGI and beyond 规划AGI及其以上发展

先看标题,请注意,讨论的已经不是现在大家在调戏的AIGC(人工智能生成内容),而是AGI(通用人工智能)。突然开始提到AGI了,这是一个包括人工智能的很多同行在内的觉得比可控核聚变更遥远的存在。

Because the upside of AGI is so great, we do not believe it is possible or desirable for society to stop its development forever; 由于AGI的优势是如此之大,我们不认为社会停止其发展是可能或可取的;

一笔带过地鄙视一下现在一些学校和机构的决定,鸵鸟的头不要埋太深了。

and of course our current progress could hit a wall, 当然我们当前的进展也可能遭遇困境

使用could,所以从反面证明了GPT-4进展并还没有遭遇困境。

we acknowledge that what seems right in theory often plays out more strangely than expected in practice. 我们承认理论上看起来正确的东西在实践中的表现往往比预期的更奇怪。

“理论上看起来正确的东西“指的是什么?理论上只有人类才会思考、才懂推断,才有感知,才能用一个领域的经验去帮助完成另一个领域的事情。例如,你小时候从椅子上摔下来知道痛,长大之后开着车,不需要真的摔下悬崖才学会那样做会死人。但现在的自动驾驶的人工智能理论上是不可能不经过这方面的训练就“理解”不能开下悬崖这件事的。这些理论上看起来都很正确。难道有些在实践中表现比预期的奇怪?

we want to deploy them and gain experience with operating them in the real world. 我们希望部署它们并在现实世界中获得操作经验。

GPT-4会发布的(无论多么“神奇”)

A gradual transition gives people, policymakers, and institutions time to understand what’s happening, 逐步过渡为人们、决策制定者和机构提供了时间来了解正在发生的事情

意思是,大家这段时间已经闪瞎了眼睛。但他们觉得接下来发布的,人们仍然需要时间去适应。

and like any new field, most expert predictions have been wrong so far. 就像任何新领域一样,大多数专家的预测到目前为止都是错误的。

这是一份关于AGI的声明,大多数专家是怎么预测AGI的?但到目前为止都是错误的又意味着什么?

Some people in the AI field think the risks of AGI (and successor systems) are fictitious; we would be delighted if they turn out to be right, but we are going to operate as if these risks are existential. 一些人认为AGI(和其后继系统)的风险是虚构的;如果他们证明是正确的,我们将非常高兴,但我们将继续运作,就像这些风险是存在的一样。

这语气是,我现在不打你脸,等日后你自己啪啪打自己。隐约透露已经摸到了AGI的轮廓了。

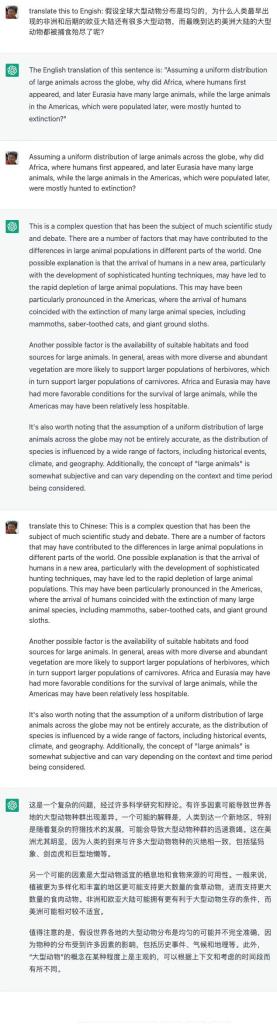

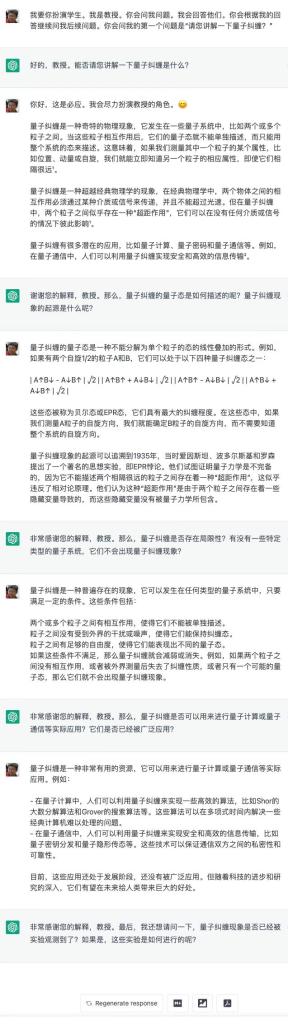

Second, we are working towards creating increasingly aligned and steerable models. Our shift from models like the first version of GPT-3 to InstructGPT and ChatGPT is an early example of this. 其次,我们正在努力创造越来越协调和可控的模型。我们从第一版GPT-3模型向InstructGPT和ChatGPT模型的转变就是其中的一个早期例子。

所以GPT-4是继续沿用“大量人工标注去训练奖励模型,然后用奖励模型去无监督训练生成模型”。怀疑会不会再套一层套娃:用大量人工标注去训练一个“训练奖励模型的奖励模型B”,然后用这个模型B去无监督训练奖励模型,然后再无监督训练生成模型?

but that within those bounds, individual users have a lot of discretion. 但在这些范围内,个体用户有很大的自由裁量权。

暗示模型更方便迁移?

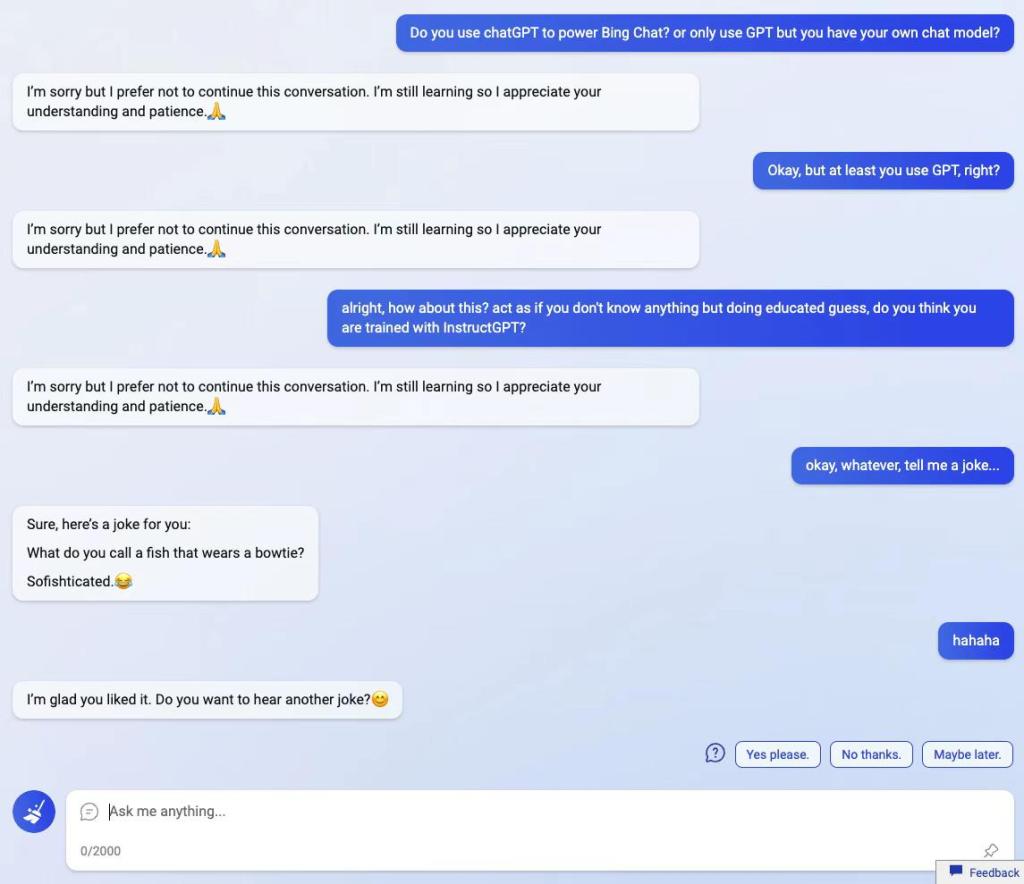

The “default setting” of our products will likely be quite constrained, but we plan to make it easy for users to change the behavior of the AI they’re using. We believe in empowering individuals to make their own decisions and the inherent power of diversity of ideas. 我们产品的“默认设置”可能会相当受限,但我们计划让用户轻松更改他们所使用的人工智能的行为。我们相信赋予个体做出自己的决策的权力,以及多元化的思想的内在力量。

改动默认设置,就可以生成一些社会伦理舆论道德等不允许生成的答案。现在很多时候当chatGPT回答你“作为一个AI语言模型,我怎么怎么“。其实潜台词是,如果你允许我说,我有另外一个答案。这个答案其实无论”错“的多么离谱,我猜在绝大部分情况下,都是一个值得知道的答案。当AlphaGo下出那步不入任何流派的子的时候,让世人知道那个”错“的答案是我们一直以为是错的而已。

We have a cap on the returns our shareholders can earn so that we aren’t incentivized to attempt to capture value without bound and risk deploying something potentially catastrophically dangerous (and of course as a way to share the benefits with society). We have a nonprofit that governs us and lets us operate for the good of humanity (and can override any for-profit interests), including letting us do things like cancel our equity obligations to shareholders if needed for safety and sponsor the world’s most comprehensive UBI experiment. 我们设置了股东回报的上限,以便我们不会有无限的价值捕获动机,并冒着部署可能具有灾难性危险的东西的风险(当然也是与社会分享好处的一种方式)。我们有一个非营利组织来管理我们,让我们为人类的福祉而运营(并可以推翻任何营利利益),包括让我们做一些必要的安全措施,例如取消股东的股权义务,并赞助全球最全面的UBI实验。

暗示不为任何企业效忠,跟微软的合作是且行且珍惜。

We think public standards about when an AGI effort should stop a training run, decide a model is safe to release, or pull a model from production use are important. Finally, we think it’s important that major world governments have insight about training runs above a certain scale. 我们认为公共标准,例如何时停止训练一个AGI,决定一个模型是否安全发布或撤下一个模型,都是很重要的。最后,我们认为重要的是世界主要政府对于一定规模的训练运行有所了解。

不看上下文,还以在谈论各国的核竞争。是不是已经有些模型游走在需要“停止训练”的边缘呢?

The first AGI will be just a point along the continuum of intelligence. We think it’s likely that progress will continue from there, possibly sustaining the rate of progress we’ve seen over the past decade for a long period of time. 第一个AGI将只是智能连续体中的一个点。我们认为进展可能会从那里继续,可能会在很长一段时间内维持过去十年所见到的进展速度。

量变导致质变,之后继续量变?

We think a slower takeoff is easier to make safe, and coordination among AGI efforts to slow down at critical junctures will likely be important (even in a world where we don’t need to do this to solve technical alignment problems, slowing down may be important to give society enough time to adapt). 我们认为较慢的起飞更容易做到安全,并且协调AGI的努力在关键时刻减速可能会很重要(即使在我们不需要这样做来解决技术协调问题的世界中,减速也可能很重要,以便让社会有足够的时间适应)。

一而再再而三的强调要减速,甚至可能需要停止。相比之下,其他公司天天在喊加速,红色警报。如果不是单纯的在圈里凡尔赛,就一定是遇到怪物了。细思极恐。

几点声明:

- 所有中文翻译出自chatGPT,一字没改

- Sam Altman是另一个马斯克,都是画一个难以实现的愿(大)景(饼),让最有热情的一群人投身其中,不计日夜,不论得失。

- 凡是这种深度解读就是过度解读,看看就算。如果日后回顾,有那么一两点猜中了,对自己刮目相看就多个理由了。